Program dokumentów technicznych SIGGRAPH jest w czołówce innowacji, łącząc zespoły z całego świata w konferencję, podczas której mogą dzielić się i rozwijać istniejące pomysły i technologie, które są budowane. SIGGRAPH 2013 odbędzie się w dniach 21-25 lipca w Kalifornii w tym roku z udziałem autorów „rozpowszechniających nowe prace naukowe w dziedzinie grafiki komputerowej i technik interaktywnych”. Oznacza to, że będą współpracować, aby wprowadzić postęp techniczny w branży, który przyspieszy nas w przyszłość. Powyższe wideo jest jedynie krótką demonstracją tylko niektórych programów, które zostaną przedstawione na konferencji w tym roku.

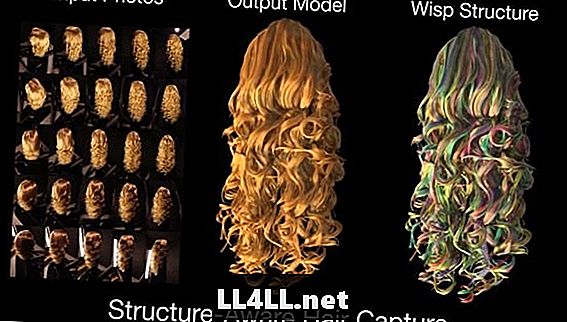

Podczas programu lista dokumentów technicznych obejmowała innowacje i ulepszenia w funkcjach projektowych, takich jak analiza kształtu, projektowanie płynów (w tym cząstki śniegu i wody), przechwytywanie światła, układ strukturalny i geometria oraz rekonstrukcja oparta na obrazie.

Zasadniczo wszystkie te funkcje działają wspólnie, aby zapewnić nam kolejne kroki w zakresie zaawansowanego przetwarzania obrazu dla naszych komputerów i konsol. Na przykład ostatnia funkcja na tej liście: rekonstrukcja oparta na obrazie. Gry będą mogły odtworzyć prawdziwych ludzi i środowiska na podstawie samych zdjęć i filmów. Używając kamer podłączonych do twojego systemu gier, możesz dokładnie odtworzyć nie tylko swój pokój, ale także własne rysy twarzy w czasie rzeczywistym. The Princeton zespół, który zaprojektował technologię, nazywa to Akwizycja modeli 3D w czasie rzeczywistym.

To prowadzi mnie do innego punktu z filmu.Trendem wśród programistów i programistów jest wykorzystanie kamer do wprowadzenia wielu z tych innowacji technicznych. Skalowalna wolumetryczna rekonstrukcja powierzchni w czasie rzeczywistym oznacza trójwymiarowe modelowanie w czasie rzeczywistym, które może przełożyć się na wykorzystanie przenośnego aparatu (powiedzmy Google Glass) do renderowania 3D całych miast. W rzeczywistości wiele z nich wykonało podobne zadania za pomocą kamery stereo (np. Kinect), lasery (LIDAR) lub sonary (chociaż używanie sonarów nie jest realistyczne z powodu fałszywych odbić dźwięku). Wielkie zastrzeżenia w tej chwili: wykonanie tej technologii w czasie rzeczywistym oznacza, że model nie będzie miał dużej rozdzielczości i że zajmie ogromną ilość mocy obliczeniowej dla realistycznych poziomów wierności. Obecnie ta technologia jest nieefektywna i jeszcze niewykonalna. Ręczne tworzenie modeli jest jeszcze bardziej opłacalne i wydajne. Zespół Standford przedstawił swój znaczący wpis dotyczący tej kwestii, wykorzystując trójwymiarowe modelowanie miast z danych na poziomie ulicy do wykorzystania w rzeczywistości rozszerzonej.

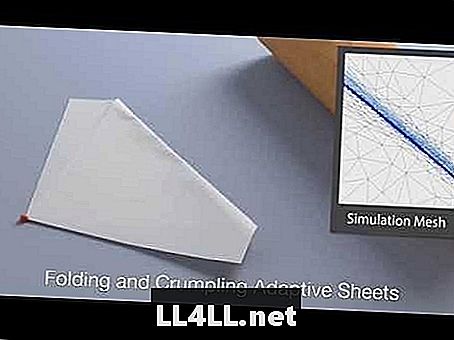

Jednym z najbardziej ekscytujących wydarzeń z tego filmu jest Folding and Crumpling Adaptive Sheets. Ta funkcja umożliwia realistyczne niszczenie materiałów, takich jak kawałek papieru, artykuł odzieżowy lub blacha.

W tej chwili wielu prawdopodobnie czyta to i gubi się w morzu technicznych brzmiących fraz i słów. Jeśli nawet otworzysz powiązane pliki .pdf, utopisz się w złożonych formułach matematycznych i żargonie programistycznym.

Co to wszystko znaczy? Wszystko, co musisz wiedzieć, to jedni z najmądrzejszych graczy i programistów na całym świecie, którzy pracują razem nad stworzeniem technologii i programów, które zwiększają nie tylko to, co jesteśmy w stanie tworzyć i robić w grach, ale także podnosimy standard tych gier. .

Te technologie mogą nie być stosowane w dzisiejszych grach, ale jak PS4, Xbox One, a zwłaszcza gry komputerowe nadal się rozwijają, będzie więcej czasu i możliwości na zastosowanie tych nowych i rozwijających się funkcji w grach jutra.

Hiperrealizm w grach wideo jest celem, który staje się coraz bardziej dostępny. Jeśli spojrzymy wstecz nawet 6 lat temu, osiągnęliśmy skoki w zakresie nie tylko grafiki, ale całej technologii.